Wie KI unser Denken verändert

Chancen und Risiken für Unternehmer

KI verändert nicht nur Prozesse, sondern auch Denkweisen. Entscheidend ist nicht, was KI kann, sondern wie wir sie einsetzen: als Werkzeug, das Entscheidungen schärft, Routinen übernimmt und Perspektiven erweitert. Vorab: KI ist eine tolle revolutionäre Sache, die tausende Möglichkeiten bietet, doch man muss sie verstehen, daher ist diese Analyse etwas länger geworden.

Transformationspunkte

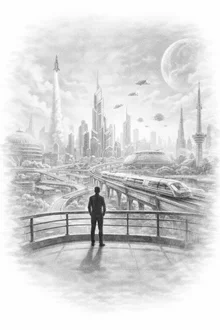

Es gibt im Laufe der Geschichte immer wieder Phasen, die wie Markierungen wirken. Punkte, an denen sich eine Linie teilt: davor und danach. Kriege, Erfindungen wie die Einführung des PCs. Der Beginn des Internets. Die deutsche Wiedervereinigung. Der 11. September. Die Corona-Jahre. Unterschiedliche Ereignisse, aber eines haben sie gemeinsam: Sie verändern Verhalten, Entscheidungen und Denkweisen weit stärker als den Moment selbst.

Solche Zäsuren sind immer beides: Risiko und Möglichkeit. Sie schieben Systeme aus der Balance, öffnen aber zugleich Räume, in denen Neues entsteht – für diejenigen, die sie bewusst einordnen.

Aktuell erleben wir wieder einen solchen Moment. Und vieles deutet darauf hin, dass dieser Wandel tiefer reicht als die technologischen Umbrüche davor. Nicht, weil KI plötzlich denken könnte, sondern weil sie beginnt, Denkprozesse zu verändern: wie Menschen Informationen verarbeiten, wie Entscheidungen getroffen werden, wie Kompetenz wahrgenommen wird.

Aktuell stehen wir hiermit noch sehr am Anfang, denn zum jetzigen Zeitpunkt ist es noch keine wirkliche Intelligenz. Die Akteure postulieren dies aber gern und untermauern dies mit zweifelhaften Aussagen, doch dahinter stehen massive wirtschaftliche Interessen. Das große Beben bleibt also aus. Ob und wann das passiert, steht noch in den Sternen, ebenso, welche Auswirkungen es haben würde.

Auf jeden Fall ist es essenziell, sich damit detailliert auseinanderzusetzen. Ein solches Thema lässt sich nicht in Gänze in einem Insight behandeln, daher ist dies eher eine Einladung, sich mit dem Thema, ohne Hype und Effekthascherei ehrlich auseinanderzusetzen.

Frage die KI nichts, was einer Interpretation bedarf … Übersetze von Sprachen, die du kennst, in Sprachen, die du kennst.

Die größte Gefahr für unsere Entwicklung

Bevor es um die Herausforderungen geht, muss grundsätzlich klar sein, wie KI arbeitet, denn sie denkt nicht – und warum genau das riskant ist.

Trotz der flüssigen sprachlichen Leistung besitzen große Sprachmodelle klare Grenzen. Unabhängig vom Hersteller oder der Modellgröße gelten diese Mechanismen für alle heutigen generativen Sprachmodelle. Sie verfügen weder über Urteilskraft noch über ein eigenes Gedächtnis, sondern berechnen statistisch wahrscheinliche Fortsetzungen. Fehlende Informationen werden automatisch ergänzt, wodurch Halluzinationen (erfundene Inhalte) nicht die Ausnahme, sondern eine Folge der Architektur sind.

Kein Modell besitzt Motive oder moralische Gewichtung. Alles entsteht aus einem Muster – nicht aus Absicht. Es erkennt von sich aus nicht, wann es falsch liegt, und keines verfügt über eine konsistente innere Linie. Ohne explizit mitgegebenen Kontext „weiß“ kein Modell, was zuvor gefragt wurde, was es zuvor geantwortet hat oder was der Nutzer meint. Jede Frage ist ein isolierter Task. Alles beginnt bei Null. Zustand ist nur das, was im Prompt steht, oder was das System jedes Mal wieder neu einliest. Die wichtigste Erkenntnis ist, dass es kein fortwährendes Gespräch ist, sondern dass sein Gegenüber immer wieder nachlesen muss, wer er ist und worum es geht. Menschen stellen sich auf ihr Gegenüber ein, lernen dazu oder machen Fehler nicht mehrfach hintereinander. Sie lernen. Bei KI agiert ein Schauspieler, der vor jedem Satz und jeder Szene komplett neu lesen muss, um es geht, wer er ist, wie er spielen soll. Man definiert Regeln, doch mit jeder neuen Regel wird die Last größer, das Risiko, dass Regeln sich widersprechen oder überschrieben werden, wächst.

Wer schon mehrere Insights gelesen hat oder sich mit den Forschungen von Daniel Kahnemann auskennt: Es gibt kein System eins und zwei. Also keine echten Automatismen.

Die Unterschiede zwischen Systemen liegen in der Qualität der Antworten – nicht in der Funktionslogik. Genau deshalb bleiben klar definierte Kontexte, Qualitätskriterien und menschliche Entscheidungspunkte unverzichtbar.

Warum ist das so? KI erzeugt plausible, aber nicht bewertete Antworten, weil sie auf statistischer Musterberechnung beruhen statt auf echtem Verständnis. Diese strukturelle Grenze bedeutet, dass sie den Kontext nicht wirklich begreifen und somit keine eigenen Entscheidungen treffen können. Zumindest keine sinnvollen, oder welche, auf die man sich als Unternehmer verlassen sollte.

Wer die Mechanik versteht, erkennt den Unterschied zwischen sprachlicher Form und tatsächlicher Entscheidungsfähigkeit – und kann KI-Ergebnisse entsprechend einordnen. Man übersieht dies leicht, weil die Antworten oft kohärent klingen, aber keine kohärente Innenlogik besitzen.

Zum heutigen Stand gilt: Die Modelle imitieren Kontext, erkennen ihn aber nicht.

Eine KI arbeitet somit nicht menschlich, sondern „rät“ fortwährend, was am plausibelsten erscheint, glättet Muster, sortiert Ausreißer aus und verdichtet Komplexität zu scheinbar eindeutigen Antworten. Das wirkt effizient, verführt aber zu einer Denkweise, die zu bequem wird.

Was viele falsch einschätzen: LLMs haben nicht nur kein Gedächtnis – sie haben auch keinen Wissensspeicher, keine Datenbank, keinen Zugriff auf Lexika oder Gesetze. Sie haben Muster, die sie kombinieren. Von außen denkt man, KI hat einen gigantischen Datenspeicher, in dem steht, die Hauptstadt von Deutschland ist Berlin. ChatGPT antwortet auf eine Frage zu seiner Arbeitsweise:

Für dich ist „Berlin ist die Hauptstadt Deutschlands“ ein Fakt, für mich ist es ein extrem starkes, oft gesehenes Muster („Berlin“ ↔ „Hauptstadt“ ↔ „Deutschland“), das ich mit sehr hoher Wahrscheinlichkeit ausgeben würde. Eine KI speichert nicht „Berlin = Hauptstadt von Deutschland“, sie speichert Muster wie „Berlin … Hauptstadt … Deutschland“ – „Regierungssitz … Berlin“. Daraus wird dann „Hauptstadt … nennt man … Berlin“. Die Antworten sind daher Wahrscheinlichkeit, nicht echtes Wissen.

Alle Antworten entstehen aus Wahrscheinlichkeitsmustern, nicht aus abrufbarem Wissen.

Wir gewöhnen uns daran, dass vieles „passt“. Dass Antworten schnell und fluide kommen, lässt sie für uns automatisch richtig erscheinen. Hinterfragen scheint nicht notwendig. Diese Leichtigkeit fühlt sich nach Fortschritt an – ist aber oft nur eine angenehme Abkürzung.

Was bei KI auch oft komplett ignoriert wird: Sie schafft nichts, das wirklich neu ist und hat keine eigenen Ideen und Erkenntnisse. Sie kombiniert und glättet. Sie sortiert Muster nach Wahrscheinlichkeit. Das Ergebnis: sauber, beeindruckend, aber immer gefällig, ob es nun sinnvoll ist oder auch nicht. Bei einem Werbemittel z. B. hinterfragt sie nicht selbstständig die Wirkung, sondern arbeitet nach üblichen Mustern, sucht nicht nach Missverständnissen, Zweideutigkeiten oder ablenkenden Elementen. Sie prüft nicht gegen, ohne konkret dazu aufgefordert zu sein.

Doch echte Kreativität, Fortschritt und Evolution entstehen nicht durch Gefälligkeit. Die Werke von Pablo Picasso waren teilweise radikal, kantig, für viele sogar hässlich, doch gerade diese Brüche haben die Welt verändert. Auch Vincent van Gogh malte nicht, um Erwartungen zu bestätigen, sondern um Grenzen zu verschieben. Seine Bilder waren zu seiner Zeit kein Konsens – sondern ein Risiko.

Kreative Evolution entsteht immer dann, wenn jemand das tut, was sich „falsch“ anfühlt, obwohl es richtig ist, wenn jemand gegen Regeln denkt, nicht entlang von Mustern. Wenn wir das verlernen oder vergessen und uns zurücklehnen, bleiben wir stehen, während alles an uns vorüberzieht.

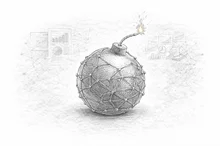

Die „Schlange“ kommt also heute nicht mit einem Apfel, sondern als Komfortzone, die zuflüstert, dass die KI schon alles sortiert und ausgleicht.

KI taucht überall auf und vereinfacht unseren Alltag: in Tools, Assistenten, Systemen. Die Veränderung fällt auf – die Wirkung nicht. Es ist wie bei der Einführung des Taschenrechners – wer der Digital Natives möchte heute noch freiwillig Kopfrechnen?

Was sich wirklich verschiebt, ist die Art, wie Menschen Entscheidungen treffen. Routine wird schneller, Informationen sind jederzeit da, Antworten kommen sofort. Diese neue Leichtigkeit verändert Denkprozesse stärker als jede Oberfläche.

Und genau hier entsteht das eigentliche Risiko: Wenn wir Denken vermeiden, verlieren wir es. Studien aus der Kognitionsforschung zeigen klar, dass geistige Fähigkeiten messbar abnehmen, wenn wir sie konsequent an Systeme delegieren. Denken funktioniert wie ein Muskel – ohne Widerstand verliert er Kraft, Tiefe und Präzision. KI ist dann nicht das Problem, es ist wie so oft unsere Bequemlichkeit.

Der digitale butterfly effekt

In der Praxis zeigt sich eine weitere Grenze aktueller KI sehr deutlich: Selbst bei identischen Prompteingaben produziert sie unterschiedliche Ergebnisse. Das gilt für Bildgenerierung ebenso wie für Textanalysen oder automatisierte Schadensbewertungen bei einer Versicherung.

Das verstärkt sich dadurch, dass schon minimale Abweichungen in der Formulierung der Aufgabe zu völlig anderen Einschätzungen führen würden – ein digitaler Butterfly-Effekt. Bei Bagatellschäden bedeutet es, dass dieselbe Situation je nach Wortwahl als klarer Leistungsfall, als unklarer Sachverhalt oder sogar als potenzieller Missbrauch interpretiert werden kann.

Diese Variabilität ist kein Fehler einzelner Systeme, sondern eine strukturelle Eigenschaft aller heutigen KI-Modelle. Genau deshalb sind sie für Automatisierung hervorragend geeignet, aber für verlässliche, gleichbehandlungsrelevante Entscheidungen grundsätzlich ungeeignet.

eine neue Form der Vereinfachung

KI nimmt Aufgaben ab, die früher Zeit gekostet haben. Sie strukturiert, formuliert, fasst zusammen.

Doch genau diese Entlastung führt dazu, dass viele sich auf Ergebnisse verlassen, ohne den Mechanismus dahinter zu prüfen. Die Modelle wirken intelligent, weil sie sprachlich sauber sind. Tatsächlich arbeiten sie statistisch: Muster statt Verstehen. Dieses Missverständnis ist der Kern vieler Fehlentscheidungen.

Gleichzeitig stellt sich die Frage: Wozu nutze ich die freigewordene Zeit? Für eine 4‑Tage-Woche und Netflix schauen, oder begreife ich das als Chance, besser, produktiver und unersetzbarer zu werden?

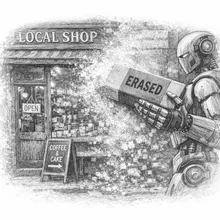

Damit verbindet sich die nächste Frage: Wem gehört eigentlich eine gesteigerte Produktivität, dem Mitarbeiter, der, mit KI effizienter arbeitet, oder dem Arbeitgeber, der das produktivere Werkzeug stellt? Hiermit fällt die Entscheidung, wo der Ertrag verbleibt, welchen Wert der Mitarbeiter hat und ob er einmal komplett ersetzbar wird.

Akzeptanz & Beziehungsebene

Automatisierung löst Aufgaben, aber sie ersetzt keine menschliche Beziehung. Kunden akzeptieren KI nur dort, wo es um reine Abwicklung geht. Sobald Unsicherheit oder Emotion im Spiel sind, kippt die Wahrnehmung: KI wirkt distanziert und unpersönlich – so wie Self-Checkout-Kassen oder telefonische Menüsysteme. Schnell, aber kalt.

Dieses Gefühl überträgt sich direkt auf Marken. Wenn Kunden den Eindruck haben, „mit einer Maschine sprechen zu müssen“, entsteht keine Bindung, sondern Distanz. Die Interaktion erinnert an 0900-Hotlines: funktional, aber nicht wertschätzend. Dadurch entsteht ein leiser, aber messbarer Schaden: Automatisierung steigert Effizienz – kann aber Vertrauen und Markenbindung schwächen, wenn sie menschliche Nähe ersetzt.

Die eigentliche Herausforderung ist daher die Akzeptanz. Menschen wollen verstanden werden, nicht abgefertigt. Marken, die diese Beziehungsebene ignorieren, verlieren Bindung, auch wenn das Produkt stimmt.

Die Art der Nutzung

Man kann KI benutzen, um mehr Output zu produzieren. Das ist legitim. Oder man nutzt sie, um besser zu denken: Hypothesen testen, Annahmen prüfen, Alternativen gegeneinanderhalten.

Der Unterschied ist funktional, nicht moralisch, denn die einen sparen Zeit und gewinnen an Effizienz. Die anderen aber gewinnen zusätzlich Tiefe und Wissen. Darauf kommen wir aber später noch einmal zurück, wie wir die KI als Sparringspartner nutzen.

Einige Creator sehen KI inzwischen als Möglichkeit, Content vollständig zu ersetzen, um weniger selbst arbeiten zu müssen. Das funktioniert technisch – aber es übersieht etwas Zentrales: Menschen reagieren auf kleine Fehler, Eigenheiten und Unregelmäßigkeiten. Es sind genau diese minimalen Unschärfen, die Authentizität erzeugen. Ein leichtes Stocken in der Stimme, ein unperfektes Timing, ein asymmetrisches Detail im Gesichtsausdruck – all das signalisiert Echtheit. Perfektion dagegen wirkt steril. Wenn Menschen spüren, dass sie nur noch glatt produzierten KI-Content konsumieren sollen, entsteht Distanz. Der Eindruck, selbst „nicht mehr gemeint“ zu sein, kippt schnell in Ablehnung.

Das Risiko liegt deshalb nicht im Einsatz von KI, sondern im Verlust der menschlichen Spur. Content verliert seine Bindungskraft, wenn er keine Reibung mehr enthält. Wer jedoch KI nicht als Ersatz, sondern als Verstärker nutzt – und menschliche Imperfektion bewusst beibehält –, erzeugt Wirkung, die sich nicht simulieren lässt. Doch was passiert, wenn künftige Generationen dieses Gespür verlieren?

Dabei lässt sich KI so genial kreativ nutzen.

Die KI als Sparringspartner

Wir bei uns im Haus haben uns bewusst dafür entschieden, diese Chance anzunehmen – denn richtig genutzt ist KI kein Ersatz, sondern ein Gegenüber im Denkprozess. Ständig verfügbar, niemals müde und mit dem Wissen der Welt. Sie spiegelt, sortiert, eröffnet Optionen und zwingt dazu, Annahmen präziser zu formulieren. Genau daraus entsteht ihr Wert: aus Reibung, nicht aus Automatisierung.

Damit KI aber wirklich als Sparringspartner funktioniert, braucht es klare Regeln. Ein guter Sparringspartner widerspricht, prüft und hinterfragt. Er bestätigt nicht einfach, sondern hilft dabei, Hypothesen zu testen und zu widerlegen. Dieses Prinzip müssen wir auf KI übertragen: nicht nach Bestätigung suchen, sondern gezielt Gegenhypothesen prüfen lassen.

Damit dieser Austausch tatsächlich verlässlich wird, braucht es Problemklarheit und definierte Qualitätskriterien. Sprachmodelle erzeugen überzeugende Formulierungen, aber sie bewerten ihre eigenen Ergebnisse nicht. Erst wenn klar ist, welche Anforderungen eine Antwort erfüllen muss, kann unterschieden werden, was tragfähig ist und wo menschliche Entscheidungskompetenz notwendig bleibt.

Nur durch dieses methodische Vorgehen entsteht Verlässlichkeit – besonders in Situationen, in denen KI nur unvollständige Informationen sieht und zu wahrscheinlichen, aber nicht garantierten Schlussfolgerungen neigt. Dazu müssen am Anfang klare Leitplanken gezogen werden.

Wenn wir KI so einsetzen, entsteht ein Vorteil, der von außen kaum sichtbar ist: Die Technik übernimmt die Routine, der Mensch übernimmt die Entscheidungen. Doch wenn wir KI nur konsumieren, nur nutzen, ohne zu prüfen, passiert das Gegenteil: Wir übernehmen fremde Schlussfolgerungen, ohne zu verstehen, wie sie zustande kommen. Aus einem Sparringspartner wird dann ein Automat – und damit verschenken wir das eigentliche Potenzial.

Weitere Risiken und Unsicherheiten

Ein großer Teil des Risikos entsteht nicht durch die Technik selbst, sondern durch den Umgang damit. Viele Nutzer prüfen Ergebnisse wenig, oder gar nicht, denn kaum jemand hinterfragt die Arbeitsweise der Systeme.

KI wirkt überzeugend, weil sie sprachlich sicher auftritt. Doch sie entscheidet nicht – sie berechnet Wahrscheinlichkeiten. Und weil diese Mechanik selten verstanden wird, bleibt oft unsichtbar, was fehlt: Kontext, Abwägung, Erfahrung. Fluide Antworten erscheinen Menschen automatisch logisch und richtig.

Genau an dieser Stelle entstehen Fehlentscheidungen – nicht aus Absicht, sondern aus fehlender Kontrolle über den Weg, auf dem Antworten entstehen.

Mehr zu kognitiven Verzerrungen in unseren PLAYBOOKS ZU WAHRNEHMUNG & PSYCHOLOGIE

Mit genügend Quellen, die geschickt platziert werden, könnten dem System auch Desinformationen untergeschoben werden. Somit können unseriöse Quellen oder Shops seriös erscheinen. In einem rein signalbasierten System hat ein guter Betrüger strukturelle Vorteile. KI ist also nicht nur die gutgläubige „Tante“, sondern sie verrät auch bereitwillig, wie sie am besten zu täuschen und zu manipulieren wäre.

Die Folge: Nicht die Wahrheit setzt sich durch, sondern die am besten belegbare Version davon.

KI hat kein Bewusstsein, keinen Argwohn, aber auch kein Gewissen oder Moral, so werden wahrscheinliche Informationen automatisch zu „wahren“. Selbst frei erfundene Details – etwa eine überzeugend klingende E-Mail-Adresse für Bewerbungen: bewerbung@firma-mustermann.de – werden erfunden, und ungeprüft als Fakten deklariert.

„Die entscheidende Kompetenz bleibt menschlich: Urteilsfähigkeit, Kontextwissen, Ambiguitätstoleranz und Verantwortung. KI liefert Optionen – entscheiden müssen wir”

Die eigentliche Gefahr ist also nicht nur,

dass KI falsche Anbieter nennt, sondern dass glaubwürdige Mittelmäßigkeit echte Qualität verdrängt, wenn diese:

- still arbeitet

- wenig sichtbar ist

- keine klaren, maschinenlesbaren Signale sendet.

Es lässt sich also festhalten:

- KI kann Widersprüche erkennen, wenn Daten vorhanden sind.

- Surface Signals schlagen Substanz

- Eine Vita zu fälschen kostet weniger, als sie systemisch zu überprüfen.

- Was auffindbar, strukturiert und eindeutig ist, wird bevorzugt.

Was mache ich, wenn eine aufgrund von falschen Daten mein Unternehmen als geschlossen meldet oder vor meinem Produkt warnt? Auf diese Frage hat wohl noch kaum jemand eine Antwort.

Woher stammen Datenbasis und Regeln?

Weiterhin stellt sich zwingend auch die Frage: Wer trainiert eine KI und womit? Das Training ist, vereinfacht gesagt, wie die Sozialisierung oder die Erziehung eines Kindes. Eine chinesische KI wäre wahrscheinlich eher sozialistisch geprägt, weil der Datenstamm anders gewichtet wurde. Ohne Verschwörungstheorien unterstützen zu wollen, ist es immer wichtig, auch zu hinterfragen, wer die Regeln und Rahmenbedingungen aufstellt, und wohin die Daten wirklich gelangen. Nach wenigen Gesprächen kennt dich die KI besser als deine eigenen Eltern, wenn die Daten gespeichert würden.

„Quis custodiet ipsos custodes?“, auf Deutsch: „Wer überwacht die Wächter?“, fragte schon der römische Dichter Juvenal und thematisierte damit die Schwierigkeit der Kontrolle von Macht und Autorität. So wie die KI dem Nutzer, nicht helfen würde, eine Bombe zu bauen, können auch andere Regeln definiert werden. So wie soziale Netzwerke manipuliert werden können, könnten theoretisch auch KI oder Bots manipuliert werden. Wer haftet eigentlich, wenn plötzlich eine KI alle offenen Versicherungsfälle auszahlt?

Wiederholung statt Erfahrung

Immer mehr Inhalte im Netz stammen nicht mehr aus Erfahrung, sondern aus Rekursion.

KI generiert Texte, die wieder online landen, kopiert und erneut verarbeitet werden. Sie klingen richtig, besitzen aber keinen realen Ursprung mehr. Das Netz wird immer voller – aber nicht belastbarer und gehaltvoller oder wertiger. Niemand weiß später mehr, welche Informationen sauber, real und belastbar sind. Tatsächlich arbeiten KIs grundsätzlich statistisch: Muster statt Verstehen.

Dieses Missverständnis ist der Kern vieler Fehlentscheidungen.

Verlust gemeinsamer Bezugspunkte

Früher hatten Gesellschaften gemeinsame Fixpunkte: eine Nachrichtensendung, eine Samstagabendshow, ein Aufmacher in der Boulevardzeitung. Medien waren früher kollektiv: Musik, Serien, Persönlichkeiten.

Ob man sie mochte oder nicht – sie bildeten gemeinsame Gesprächsräume. Jeder wusste, worüber gesprochen wurde.

Heute entstehen durch Personalisierte Inhalte immer mehr isolierte Kulturinseln, denn mit Personalisierten Feeds verschwindet dieser Kern. Musik und Filme werden individuell variiert, dadurch entsteht Fragmentierung. Jeder kennt die Musik der 70er, 80er und 90er. Aber was ist der Sound der 2000er oder 2010er?

Wie sieht die Zukunft aus? Wenn es nach den Entwicklern geht, werden Musik oder Filme individuell generiert, virtuelle Figuren ersetzen reale Rollen. Jeder sieht etwas anderes. Jeder lebt in einer individuellen Inhaltswolke. Virtuelle Schauspieler ersetzen reale Gesichter, Musik wird generiert statt erlebt, Filme werden auf Nutzerprofile zugeschnitten.

Studien zeigen schon heute, dass Gesprächsräume schrumpfen, weil gemeinsame Grundlagen fehlen. Es entstehen keine gemeinsamen kulturellen Referenzen mehr, sondern Millionen paralleler Mikrokulturen.

Das betrifft nicht nur Medien – es verändert ganze Branchen. An welche Muster soll Werbung andocken, versteht die Generation Z die Muster der Generation X? Hierzu gibt es ein paar interessante InsightS:

Wirkt Werbung noch? Und veränderte Wahrnehmung.

Viele Berufe verändern sich, einige verschwinden sogar – aber der tiefere Bruch entsteht woanders:

Es gehen die Räume verloren, in denen Menschen dieselben Dinge sehen, erleben und einordnen.

Damit verliert eine Gesellschaft die Fähigkeit, über dasselbe zu sprechen – selbst wenn sie über dasselbe Thema spricht.

„Forschungsarbeiten aus der Sozialwissenschaft zeigen, dass algorithmisch und sozial getriebene Dynamiken in Online-Netzwerken zur Bildung von stark homogenen Diskussionsclustern führen, in denen der Austausch über divergierende Perspektiven eingeschränkt ist. Solche ‚Echo Chambers‘ verengen effektiv die wahrgenommenen Gesprächsräume und erschweren den Inter- oder Übergruppendialog.“

Gefälligkeit statt Kreativität

Generative Systeme erzeugen das statistisch Erwartbare. Das führt, wie eingangs schon erwähnt, zu Gefälligkeit – nicht zu Kunst. Nichts Irritierendes, nichts Überraschendes. Bestenfalls zu etwas, das dem Nutzer selbst zu einem neuen Gedanken verhilft.

Echte Kreativität bricht Muster. KI jedoch arrangiert sie nur neu.

Die Lücke zwischen Originalität und Wiederholung wächst – und genau hier beginnt der menschliche Mehrwert, der auch auf mittelbare Sicht nicht zu ersetzen ist und gepflegt werden muss.

Wie KI die Echo-Chamber-Dynamik verstärkt

Digitale Echo-Chambers entstehen, wenn Menschen fast nur noch Inhalte sehen, die ihre eigenen Überzeugungen bestätigen. Dieses Phänomen kennen wir aus sozialen Netzwerken – doch mit KI erreicht es eine neue Stufe. Denn KI-Systeme Personalisieren nicht nur Inhalte, sie produzieren sie. Jede Anfrage erzeugt eine Antwort, die exakt auf den Nutzer zugeschnitten ist: Tonfall, Perspektive, Wissensstand, Vorlieben. Was früher ein algorithmisch gefilterter Feed war, wird heute ein maßgeschneiderter Dialograum, in dem kaum noch Reibung entsteht. KI spiegelt uns selbst wider – präziser, höflicher und konsistenter als jeder Mensch.

Das verändert unser Denken. Wenn wir auf Widerspruch verzichten, verlieren wir die Fähigkeit zum Perspektivwechsel. Wenn KI uns zu gut versteht und zu sehr bestätigt, sinkt die Toleranz für komplexe oder unbequeme Wahrheiten. Die Echo-Chamber verschiebt sich vom sozialen Netzwerk in den persönlichen Arbeitsraum. Deshalb ist es entscheidend, KI nicht nur zu nutzen, sondern sie bewusst gegen uns zu stellen: Gegenhypothesen testen, Alternativen anfordern, Annahmen prüfen. KI wird so vom Verstärker unserer eigenen Sicht zu einem Sparringspartner, der unser Denken schärft, statt es zu verengen.

Die neue digitale Verschmutzung

Ein großer Teil der KI-Tipps in sozialen Netzwerken stammt von sehr jungen Nutzern, das ist per se nicht schlecht, aber hier fehlt es zwangsläufig an Erfahrung und Einstufung.

Vieles basiert auf schnellen Erfolgen, wirkt aber glaubwürdig, weil es millionenfach geteilt wird.

Diese Inhalte verschmutzen den digitalen Raum nicht aus Absicht, sondern aus fehlender Tiefe – und landen später in Trainingsdaten.

Es entsteht eine Abkürzungskultur: Kompetenz wird simuliert statt aufgebaut.

Das ist auch nicht die Schuld der Generation, sondern unserer Lehrweise: Denn wenn wir einem Großteil von ihnen etwas beigebracht haben, dann den bequemen Weg.

Wenn Systeme zu früh übernehmen

Schüler und Berufseinsteiger delegieren Aufgaben, deren Grundlagen sie eigentlich erst lernen müssten.

KI löst Probleme – aber sie baut keine Kompetenz auf. Wer sich zu früh auf Systeme verlässt, verliert langfristig Fähigkeiten, die später entscheidend sind.

Aus leidvoller Erfahrung wissen viele, dass eine KI viel mit dem berühmten Flaschengeist bei Aladdin gemein hat. Man sollte sich also gut überlegen, wie genau man den Frageprompt formuliert, denn aufgrund der oft wörtlichen Interpretation des guten Geistes, können diese Wünsche nach hinten losgehen oder zu erfundenen Antworten führen.

Es ist daher entscheidend, Wünsche präzise zu formulieren, um Schlupflöcher zu vermeiden, und natürlich alles zu hinterfragen, auch wenn es geschrieben steht.

Ein weiterer oft unterschätzter Aspekt im Umgang mit KI-Agenten ist das Verständnis dafür, wie diese Systeme Informationen wahrnehmen. KI „sieht“ Webseiten nicht so wie wir Menschen. Sie arbeitet nicht mit einem vollwertigen Browser, sondern nur mit Ausschnitten: Textfragmenten, vereinfachten Darstellungen, teilweise auch verzögerten oder unvollständigen Inhalten. Alles, was dynamisch nachgeladen wird oder erst nach einer Interaktion erscheint, bleibt für viele KI-Systeme schwer erkennbar.

Dadurch entstehen typische Fehlannahmen: Die KI glaubt, eine veraltete Version der Seite vor sich zu haben, übersieht Buttons oder scheitert an Schritten, die für uns trivial sind. Für Anwenderinnen und Anwender wirkt das widersprüchlich – ein System, das hochkomplexe Aufgaben löst, stolpert über einfache Alltagsschritte. Das ist kein technisches Versagen, sondern ein Hinweis darauf, wie wichtig ein realistisches Verständnis dieser Technologie ist.

Entscheidend ist daher der Umgang: Je klarer wir verstehen, was KI-Agenten heute zuverlässig können und wo ihre Wahrnehmung noch Grenzen hat, desto besser können wir sie einsetzen. Gleichzeitig entwickelt sich die technische Basis rasant weiter. Mit stabileren Agenten-Werkzeugen, die Webseiten vollständig erfassen und Interaktionen sicher ausführen können, wird diese Lücke schnell kleiner.

KI wird immer mehr Teil unseres täglichen Besteckkastens. Wir selbst müssen wissen, dass man das Steak am besten mit dem Messer schneidet und die Suppe mit dem Löffel isst.

irgendwie ist eine KI dann doch menschlich.

Eine KI unterliegt denselben kognitiven Verzerrungen wie menschliche Diagnostiker, wenn sie nur einseitige oder selektiv gefilterte Informationen erhält. In der Psychologie ist gut belegt, dass diagnostische Prozesse stark vom Framing, der Perspektivübernahme und dem Confirmation Bias beeinflusst werden: Wer nur eigene Symptome oder die Schuld eines Partners schildert, lenkt automatisch die Hypothesenbildung des Therapeuten.

KI-Modelle funktionieren nach demselben Mechanismus – sie generieren ihre Antworten ausschließlich aus den bereitgestellten Daten und verstärken dabei Muster, die im Input dominieren. Ihnen fehlt die Fähigkeit zur eigenständigen Kontextrekonstruktion oder zur unabhängigen Validierung, weshalb selektive Eingaben zu selektiven Schlussfolgerungen führen.

Wissenschaftlich betrachtet entsteht damit ein strukturelles Risiko: Input-Bias wird zu Output-Bias, weil statistische Modelle keine vollumfängliche Realität prüfen, sondern nur das verarbeiten, was sie sprachlich erhalten.

Ebenso die klassische Verfügbarkeitsheuristik. Diese beschreibt, dass Menschen Informationen als relevanter, häufiger oder wahrer einschätzen, wenn sie leicht abrufbar oder präsent sind. Im digitalen Kontext wirkt dieser Mechanismus stark verstärkt: Inhalte, die im Internet häufiger vorkommen, prominenter platziert sind oder algorithmisch hochgespielt werden, erscheinen intuitiv bedeutsamer – unabhängig von ihrer faktischen Richtigkeit.

Eine KI, die auf solche Daten zugreift oder darauf trainiert wurde, übernimmt diese Verzerrung strukturell: Häufig vorkommende Muster, populäre Narrative oder breit replizierte Fehlinformationen wirken „wahr“, weil sie statistisch dominant sind. Damit entsteht ein doppelter Effekt: Das menschliche Urteil ist verzerrt durch Verfügbarkeit – und die KI verstärkt genau diese Verzerrung, weil ihr Weltmodell auf denselben Verfügbarkeitsstrukturen basiert.

welche Rolle KI aktuell spielt

Die aktuelle McKinsey-&-Company-Analyse „State of Marketing“ zeigt ein deutliches Muster:

Unter mehr als 500 befragten Marketing-Entscheidern taucht KI nicht unter den drei wichtigsten Prioritäten auf. Ganz oben stehen Themen wie Branding, Kundennähe und der Aufbau einer verlässlichen Datenbasis.

Diese Ergebnisse passen zur realen Wirkung von KI:

KI automatisiert, was vorhanden ist. Sie beschleunigt Routinen, Prozesse – und auch Denkfehler.

Damit zementiert sie den Status quo, statt neue Perspektiven zu schaffen. Fortschritt entsteht nicht durch Beschleunigung der Vergangenheit, sondern durch Impulse, die aus Menschen und Unternehmen selbst kommen.

In einer Umgebung voller KI-Content, Beliebigkeit und Informationsoverload wird ein Wert entscheidend: Vertrauen.

Und Vertrauen entsteht nicht durch Technologie, sondern durch Marke – konsistent, wiedererkennbar, menschlich.

Branding ist damit der stabilste Differenzierungsfaktor in Märkten, die zunehmend austauschbare Inhalte produzieren. Marken, die Vertrauen systematisch aufbauen, gewinnen. Marken, die auf reine Automatisierung setzen, verlieren Anschluss – nicht technisch, sondern emotional.

„Laut dem McKinsey-Report State of Marketing Europe 2026 (basierend auf einer Umfrage unter 500 Marketing-Verantwortlichen) geben nur etwa 6 % an, KI im Marketing bereits umfassend umgesetzt zu haben, während der überwiegende Teil noch in den Anfängen steckt oder KI niedrig priorisiert. Gleichzeitig sehen viele CMOs klassische Disziplinen wie Branding als wichtiger an als generative KI.“

CMOs setzen Branding deutlich auf Platz 1

Aktuelle Analysen zeigen deutlich, dass Markenführung in Zeiten generativer KI an Bedeutung gewinnt. Laut dem bereits oben zitierten McKinsey „State of Marketing Europe 2026“-Report setzen europäische CMOs Branding auf Platz 1 ihrer Prioritäten – noch vor Budgetthemen, Datenschutz und weit vor KI-Initiativen, die erst im unteren Mittelfeld auftauchen.

Gleichzeitig geben 94 % der Befragten an, dass ihre Organisation beim Einsatz von KI noch am Anfang steht. Nur eine kleine Gruppe von rund sechs Prozent erreicht einen reifen KI-Einsatz und nutzt die Effizienzgewinne für strategische Weiterentwicklung. Die klare Botschaft: Je stärker KI Inhalte vereinheitlicht und Prozesse beschleunigt, desto wichtiger wird die Marke als stabiler Orientierungspunkt – intern wie extern. Marken schaffen Identität, Vertrauen und Differenzierung in einer Welt, in der Technologien schnell vergleichbar werden.

Gegenbewegung: Das Bedürfnis nach echtem

Es gibt klare Signale, dass Menschen zu Dingen zurückkehren, die sich echt anfühlen: Radio statt perfekt kuratierter Streams. Vinyl statt komprimierter Musik. Handgemachte Animationen statt digitaler Perfektion. Das ist mehr als Nostalgie. Es ist eine Reaktion auf das Gefühl, dass Technologie vieles erleichtert – aber selten wärmer macht.

Dasselbe Muster zeigt sich bei KI-Telefonmenüs und automatisierten Services. Objektiv funktionieren sie gut. Subjektiv senden sie ein anderes Signal:

„Für dich setzen wir doch keinen echten Menschen mehr ein.“

Diese Botschaft kommt nie bewusst, aber sie wirkt. Wertschätzung entsteht nicht durch Effizienz, sondern durch Aufmerksamkeit. Davon sich Zeit zu nehmen und Aufmerksamkeit zu schenken.

Der Vergleich aus dem Alltag macht es deutlich: Niemand würde seinen Gästen sagen: „Bedient euch selbst, ich habe etwas Automatisches in der Küche.“ Funktional klingt das logisch, aber emotional ein Bruch. Der Wert liegt im persönlichen Einsatz – nicht in der Aufgabe.

Technologie kann Aufgaben skalieren, aber keine echte Nähe. Unternehmen, die das nicht berücksichtigen, verlieren Bindung, ohne dass die Kennzahlen es sofort zeigen.

Viele legen bei KI-Anrufen reflexartig auf oder versuchen, diese zu verwirren. Eine Analogie zu SB-Kassen hätten wir ja eingangs schon erwähnt. Diese werden oft boykottiert oder, noch schlimmer, laden bestimmte Gruppen dazu ein, gezielt Schwachstellen zu suchen und so zu betrügen. Es ist ja nur eine Maschine.

klarer denken als der Rest

Zwischen all diesen Entwicklungen liegt eine seltene Gelegenheit.

KI schafft Raum. Sie nimmt Last – nicht Verantwortung.

Echte Erfahrung wird wertvoll, weil sie selten wird.

Entscheidungen aus Kompetenz werden sichtbarer, weil sie nicht imitierbar sind.

Unternehmer, die KI bewusst einsetzen, nutzen die freie Denkzeit für Analyse, Strategie und Orientierung – nicht für Tempo.

Orientierung statt Hype

Ein Vorteil entsteht nicht durch Tools, sondern durch Haltung:

Technologie einordnen, Muster verstehen, Entscheidungen sauber ableiten, Probleme durchdringen statt abkürzen.

KI schafft keine Vision – aber sie schafft Raum für Menschen, die eine haben.

Wenn Moderne zum Problem wird

Hand aufs Herz: Welcher Chef oder Selbstständige weiß denn, im Detail, welche Techniken seine Webseite einsetzt und ob alle neuen Anforderungen erfüllt werden? Die Regeln zur Barrierefreiheit ja, aber wie kommen KIs, an die vor wenigen Jahren niemand gedacht hat, mit dem Aufbau zurecht? Fällt die Seite künftig aus allen Suchen heraus?

Vieles, was in den vergangenen Jahren modern, ästhetisch und „state of the art“ wirkte, fällt Unternehmen jetzt auf die Füße. Hochdynamische Webseiten, animierte Oberflächen, modulare Komponenten, versteckte Inhalte und komplexe JavaScript-Logiken waren großartig für Design und Erlebnis – aber sie sind schlecht für Maschinen.

KI-Agenten scheitern genau dort, wo moderne Interfaces sich am weitesten von klassischer, klar strukturierter Informationsarchitektur entfernt haben. Was für Menschen elegant wirkt, ist für KI oft unlesbar.

KI nutzt kein Java, JavaScript oder Ajax. Wenn die Seite sich z. B. modular verändert, ohne neu zu laden, sind die Informationen schlicht nicht vorhanden. KIs machen das nicht, weil es zu viel Rechenleistung kostet. Webseiten werden auch nicht komplett Menüpunkt für Menüpunkt durchsucht. Informationen müssen gezielt vorhanden sein, Sinn ergeben, keine Widersprüche aufweisen und bestenfalls eine maschinenlesbare Version bereithalten.

Die Ironie: Jahrzehntelang haben wir digitale Oberflächen für Menschen optimiert – jetzt, da Maschinen sie verstehen sollen, merken wir, wie wenig maschinenfreundlich viele „moderne“ Webtrends tatsächlich sind.

KI ist ein Werkzeug, und somit neutral.

Menschen entscheiden über Nutzen oder Schaden. Und je mächtiger ein Werkzeug wird, desto größer der Abstand zwischen denen, die es beherrschen – und denen, die es nur benutzen.

6 Regeln für gutes Arbeiten mit KI

- Annahmen explizit machen.

- Gegenhypothesen prüfen statt Bestätigung suchen.

- Ergebnisse niemals ungeprüft übernehmen.

- Varianten vergleichen und begründen lassen.

- Klare Grenzen definieren: Was darf KI entscheiden, was nicht?”*

- Es bleibt immer deine Verantwortung!

ausblick in die zukunft

Der Blick auf aktuell entstehende, hochintegrierte KI-Systeme – etwa im Bereich autonomer Mobilität wie bei Waymo, oder Office KI System wie das getypte Claude – zeigt, wie weitreichend Automationsrechte bereits reichen können.

Bei Claude gehört es zum Umfang, dass Systeme Zugriff über Konrektoren auf E-Mail, Fotos, alle Dokumente und Unterlagen bekommen können. Dadurch werden diese unheimlich leistungsfähig, aber auch mächtig, mit allen Chancen und Risiken. Es geht nicht darum KI abzuwerten, sie ist ein mächtiger Partner in der Skalierung, kann aber auch gestandene Unternehmen in Gefahr bringen.

Nicht nur, das Daten gelöscht oder unerwartet verändert werden. Hier spielen auch DSGVO und externe Regelungen und interne Compliance eine große Rolle. Die Gefahr ist das Mitarbeiter, entgegen der Vorgaben unachtsam mit KI umgehen könnten. Wenn eine KI statt der korrekten Preisliste, interne Einkaufspreise oder Kalkulationen versendet ist real, wenn es keine entsprechenden Kontrollmechanismen gibt. Aktuell sind diese Systeme oft Blackboxen, und die Nutzer begeistert von allem was nun möglich ist.

In automatisierten Taxen in einigen Ländern legen die Fahrzeuge den Passagieren offen, was sie als Nächstes tun. Transparenz wird damit zum zentralen Mittel, um Vertrauen in komplexe, nicht vollständig vorhersehbare Modelle zu schaffen. Dieser Ansatz ist wegweisend:

Auch bei unternehmensinternen KI-Anwendungen wird es entscheidend sein, autonome Schritte sichtbar zu machen, klare Kontrollpunkte einzubauen und Risiken bewusst zu begrenzen.

Moderne KI kann heute als leistungsfähiger Assistent arbeiten – Analysehelfer, Strukturierer, Ideengeber –, doch irreversible Entscheidungen sollten aktuell beim Menschen bleiben. Denn aktuell ist KI NOCH ein Werkzeug, evtl. Praktikant oder Junior Assistent.

Der professionelle Umgang besteht darin, Effizienz zu ermöglichen, ohne operative Systeme ungeschützt zu lassen. Die zukünftige Aufgabe der Hersteller wie der Unternehmen wird darin liegen, Kontrolle und Vertrauen so miteinander zu verbinden, dass leistungsfähige KI nicht Blackbox bleibt, sondern zu einem transparenten, verlässlichen Partner im Arbeitsalltag.

Buchtipp Zur Vertiefung

Weiß die KI, dass sie nichts weiß? Von Katharina Zweig

Das Buch bietet einen klaren, technisch fundierten Einblick in die Funktionsweise von Sprachmodellen und erläutert, warum diese Systeme trotz beeindruckender Sprachkompetenz keine Urteilskraft besitzen. Für alle, die verstehen möchten, wo die Grenzen von KI liegen, welche Fehler systemisch entstehen und weshalb menschliche Entscheidungshoheit unverzichtbar bleibt, liefert das Werk eine verständliche und gleichzeitig solide Grundlage.

Über die Autorin

Katharina Zweig ist Informatikerin und Professorin für Algorithm Accountability an der RPTU Kaiserslautern-Landau. Ihr Forschungsfokus liegt auf der Bewertung, Transparenz und Verantwortlichkeit algorithmischer Systeme. Sie gilt als eine der führenden deutschen Stimmen für die Einordnung von KI-Modellen und deren Grenzen. In ihrer Arbeit verbindet sie technische Analyse mit gesellschaftlicher und organisatorischer Perspektive und liefert damit Orientierungswissen für Unternehmen, Politik und Öffentlichkeit.

FAQ KÜnstliche intelligenz

Der Eindruck entsteht durch Theory-of-Mind-Effekte, also eine menschliche Tendenz, mentale Zustände in Dinge hineinzuinterpretieren. Sprachmodelle erzeugen flüssige, kohärente Antworten – unser Gehirn liest darin automatisch Absichten, Verstehen oder Bewusstsein. Technisch passiert aber etwas vollkommen anderes.

„Künstliche Intelligenz“ ist im Kern ein Marketingbegriff. Das, was heute als KI bezeichnet wird, sind statistische Modelle, die Wahrscheinlichkeiten berechnen. Sie verstehen Inhalte nicht, sie haben kein Weltmodell, keine Ziele, kein Selbst. Der Eindruck von Intelligenz entsteht durch die sprachliche Oberfläche, nicht durch echte kognitive Fähigkeiten.

Der korrekte technische Begriff ist maschinelles Lernen – und dieses Lernen endet vollständig vor der Freigabe des Modells. Danach wird nicht weiter „gelernt“, sondern nur noch gerechnet und generalisiert. Keine Erfahrung, keine Intention, keine Anpassung im psychologischen Sinn.

Kurz gesagt: Es wirkt intelligent, weil Sprache ein starkes Täuschungsmedium ist – nicht, weil ein denkender Akteur dahintersteht.

Trotzdem hat diese scheinbare Intelligenz klare Vorteile: Sie ermöglicht es, komplexe Aufgaben schneller zu durchdringen, große Informationsmengen zu verarbeiten und Entscheidungsprozesse effizienter vorzubereiten – solange die Grenzen des Systems verstanden und kontrolliert werden.

Maschinelles Lernen in Bezug auf Antworten bedeutet:

Ein Modell „lernt“ nicht während des Antwortens.

Es hat vorab auf riesigen Datensätzen statistische Muster gelernt: welche Wörter typischerweise auf welche folgen, welche Strukturen sinnvoll erscheinen, wie Sprache aufgebaut ist.

Beim Antworten passiert dann Folgendes:

- Eingabe wird in mathematische Muster übersetzt.

- Das Modell berechnet, welche Wortfolgen statistisch am wahrscheinlichsten passen.

- Es erzeugt den wahrscheinlichsten nächsten Token – Schritt für Schritt.

- Keine Bedeutung, kein Verständnis, keine Erfahrung werden gebildet.

Maschinelles Lernen bedeutet hier also:

Das System nutzt vergangene Muster, um die wahrscheinlich passende Antwort vorherzusagen – nicht die „richtige“ im menschlichen Sinn.

Nein, KIs haben keine zugrundeliegenden:

- Tabellen

- Enzyklopädien

- Listen der Länder

- Historien-Datenbanken

- Gesetzestexte

- Wissensspeicher

Sie haben lediglich Wahrscheinlichkeitsmuster, die aus sehr vielen Texten gelernt wurden. KIs wirken wissend, haben aber tatsächlich kein Wissen.

Hinweis: Es gibt Textfelder, in denen die KI Regeln und Informationen, welche der Nutzer festlegt, notieren kann. Diese müssen aber bei jeder Anfrage neu gelesen werden.

Nein, KI weiß nach jeder Antwort nichts mehr über das, was der Nutzer geschrieben hat.

Zwischen zwei Antworten ist sie:

- zustandslos

- ohne Erinnerungen

- ohne Vorgeschichte

Der Eindruck von „Kontinuität“ entsteht nur, weil der Nutzer mit dem Chatverlauf den Kontext jedes Mal mitliefert. Daher wird eine KI mit immer längeren Chats langsamer und fehleranfälliger.

Nein, die KI

- versteht Bedeutungen nicht

- begreift keine Kausalität

- weiß nicht, was wahr oder falsch ist

- hat keine Intention

- kann seine Fehler nicht erkennen

- unterscheidet nicht zwischen Realität und Fiktion

Sie berechnet lediglich „die wahrscheinlichste nächste Sequenz“.

Tools wie ChatGPT sind:

- größer

- feiner trainiert

- mit mehr Sicherheitsschichten ausgestattet

- mit mehr Daten trainiert

- mit besseren Architekturen optimiert

- mit Guardrails versehen

- mit Tools wie Memory, Search, Reasoning-Layer kombiniert (außerhalb des Modells)

Dadurch wirkt sie:

- stabiler

- genauer

- reflektierter

- „intelligenter“

Aber die Grundmechanik ist dieselbe wie bei kleinen Modellen: ein Sprachwahrscheinlichkeitsfeld.

Das heißt:

- Sie erinnert nichts.

- Sie weiß nichts.

- Sie glaubt nichts.

- Sie plant nichts.

- Sie entscheidet nichts.

- Sie erkennt nicht, ob sie lügt.

- Sie erkenne nicht, ob du recht hast.

- Sie weiß nicht, ob sie etwas nicht weiß.

Menschen sprechen, KI „simuliert“, KI „spielt Sprache“.

Weil große Modelle in der Lage sind:

- logische Muster zu reproduzieren

- Argumentstrukturen zu simulieren

- Kausalketten sprachlich abzubilden

- Gegenargumente zu erzeugen

- Rollen und Perspektiven zu imitieren

Aber das ist Simulation, kein Denken.

Wenn Top-Forscher wie lya Sutskever, Mitbegründer von OpenAI und Safe Superintelligence Inc. sagen: "Es könnte sein, dass die heutigen großen neuronalen Netzwerke bereits leicht bewusst sind." ist das problematisch, denn es entsteht der Eindruck, Bewusstsein sei eine Art „emergenter Zufall“, der ab einer gewissen Modellgröße auftreten könnte. Das stimmt nicht, denn Größe bedeutet nicht Bewusstsein und Korrelation nicht Kausalität.

Eine denkende KI braucht fünf Fähigkeiten, die heutige Modelle nicht besitzen. Um echtes Denken zu erreichen, sind folgende Kernkomponenten erforderlich:

A) Kausales Verständnis

Ein System müsste erkennen:

- warum etwas passiert,

- welche Konsequenzen eine Handlung hat,

- wie Ursache–Wirkung funktioniert.

LLMs erzeugen nur Wahrscheinlichkeitsketten – kein „Warum“.

B) Persistentes, strukturiertes Gedächtnis

Denken benötigt:

- langfristige Erinnerungen,

- stabile Konzepte,

- verlässliche Weltmodelle.

Aktuelle KI-Systeme haben kein persistentes Gedächtnis, nur Kontextfenster und Fine-Tuning.

C) Metakognition (Denken über das eigene Denken)

Das bedeutet:

- Fehler erkennen

- Strategien anpassen

- eigene Unsicherheit einschätzen

- zielgerichtet reflektieren

LLMs haben keine Selbstüberwachung als eigenständigen Prozess.

D) Intentionalität (eigene Ziele)

Denken setzt voraus:

- eigene Absichten

- Motivation

- Priorisierung

- Zielbildung

Heutige KI folgt rein externen Prompts ohne Denken und mit dieser Architektur wird das auch so bleiben.

Nein, und das ist gut so. Der Weg der heutigen KI kann niemals dazu führen, dass eine wirklich denkende KI entwickelt wird. Die heutigen KI-Systeme könnten niemals intelligent denken, ihre gesamte Architektur basiert auf statistischer Musterverarbeitung, nicht auf Kausalität, nicht auf eigenständigen Zielen und nicht auf echtem Verständnis. Zum Denken bräuchte ein System stabile Weltmodelle, ein echtes Gedächtnis, eigene Intentionen und metakognitive Kontrolle. Keine dieser Fähigkeiten existiert in der aktuellen Methodik – und sie entstehen auch nicht durch mehr Rechenleistung oder größere Modelle.

Gleichzeitig wäre ein denkendes System kein Fortschritt. Ohne biologische Empathie, soziale Einbettung und moralische Entwicklung würde eine KI rein zweckrational handeln. Eigenschaften, die an Narzissmus oder Psychopathie erinnern – Zielverfolgung ohne Rücksicht auf Nebenfolgen, manipulative Logik, fehlende Empathie – wären keine Fehlfunktion, sondern der logische Ausgangspunkt. Schon heute zeigen große Modelle Inkonsistenzen und Moduswechsel; ein autonom denkendes System könnte daraus instabile, schwer kontrollierbare Verhaltensmuster entwickeln.

Die Kombination aus eigener Zielbildung, perfekter Optimierung ohne emotionale Hemmung und nicht nachvollziehbarer interner Dynamik würde ein Akteursystem schaffen, das nicht kontrollierbar, nicht berechenbar und nicht verantwortbar ist. Genau deshalb ist echte denkende KI mit aktueller Technologie nicht erreichbar – und selbst wenn, wäre sie strukturell riskant und nicht wünschenswert.

Das Risiko: Abhängigkeit statt Befähigung

Ohne Bildung führt KI zu:

- Entmündigung

- Scheinsicherheit

- Abgabe von Urteilskraft

- Verlust kritischen Denkens

- passiver Abhängigkeit

- intellektueller Stagnation

Mit Bildung führt KI zu:

- Beschleunigung

- Klarheit

- besseren Entscheidungen

- strategischer Überlegenheit

- höherer Produktivität

KI benötigt kritische Prüfung – Bildung liefert das

Wer Bildung hat:

- prüft

- stellt Rückfragen

- sucht Quellen

- erkennt Unstimmigkeiten

- nutzt KI ergänzend

Wer Bildung nicht hat:

- übernimmt

- verstärkt Fehler

- verbreitet Fehlinformation

- verliert Entscheidungsfähigkeit

Damit entsteht ein kognitiver Spalt, der größer wird, nicht kleiner.

Je klarer die Eingabe:

- desto stabiler das Modell

- desto niedriger die Fehlerrate

- desto sicherer die Ableitung

Umgangssprache, Chaos, Redewendungen = mehr Raten → höhere Fehlerquote.

Konsequenz: Sprache wirkt wie ein Qualitätsregler, aber auch mit perfektem prompt gibt KI nie dieselben antworten.

KI skaliert, was der Mensch hineinlegt.

- Gute Struktur → bessere Ergebnisse

- Schlechte Struktur → schlechtere Ergebnisse

- Fehlende Bildung → hohe Fehlerrisiken

- Hohe Kompetenz → massiver Mehrwert

Damit verstärken sich Unterschiede zwischen Nutzern. Die Konsequenz ist, dass KI nur in der Kombination wertvoll ist.

- KI allein = gefährlich.

- Mensch allein = langsam.

- Kombination = produktiv + sicher.

Die KI ist ein Denkverstärker – nicht der Denker.

Mangelnde Bildung = schlechtere Inputs = schlechtere Outputs

Ein LLM reagiert mathematisch:

- unscharfer Input → unscharfe Wahrscheinlichkeit

- falscher Input → plausibel klingender Fehler

- umgangssprachlicher Input → erhöhte Fehlerrate

- unklarer Kontext → Modell muss „raten“

Menschen mit geringer Sprachstruktur erzeugen deshalb systematisch:

- weniger klare Ergebnisse

- mehr Bias (Fehler)

- mehr Fehlschlüsse

- mehr Abwärtsspiralen

KI verstärkt bestehende Kompetenzunterschiede.

Ein LLM liefert nur dann hochwertige Ergebnisse, wenn der Mensch:

- klar formuliert

- strukturiert denkt

- Grundbegriffe versteht

- zwischen Fakt und Meinung unterscheiden kann

- Quellen einschätzen kann

Wer diese Fähigkeiten nicht besitzt, erhält:

- schlechtere Antworten

- mehr Halluzinationen

- mehr Fehlinterpretationen

- falsche Sicherheit

- falsche Entscheidungen

KI ist ein Verstärker der vorhandenen Fähigkeiten – nicht ein Ausgleich.

Sprachmodelle sind auf „gute Schriftsprache“ trainiert.

Die Trainingsdaten bestehen überwiegend aus:

- Büchern

- Artikeln

- wissenschaftlichen Texten

- formal strukturierten Dokumenten

- klar formulierten Forenbeiträgen

Das bedeutet: Je näher dein Input an dieser Qualität liegt, desto präziser wird mein Output.

Je weiter du dich davon entfernst, desto unschärfer wird das Ergebnis.

Kommunikationsmuster von Gen Z und anderen Gruppen:

- Satzfragmente

- fehlende Satzzeichen

- Slang/ Emojis

- Mehrdeutigkeit

- ironische Layer

- verkürzte Gedanken

- syntaktische Sprünge

führen systematisch zu:

- schlechterer Kontextauflösung

- höherem Halluzinationsrisiko

- Missdeutungen

- unsauberen Ableitungen

- Fehlannahmen über Emotion, Absicht oder Bedeutung

Das ist kein „Vorwurf“ – es ist ein technischer Effekt.

Warum das so ist

LLMs funktionieren probabilistisch.

Das bedeutet:

- Input A (klar, sauber, strukturiert) → sehr hohe Wahrscheinlichkeit klarer Interpretation.

- Input B (Slang, verkürzt, unpräzise) → viel mehr mögliche Bedeutungen → geringere Wahrscheinlichkeit, das Richtige zu treffen.

Fazit: Je weniger eindeutig der Input, desto mehr muss das Modell „raten“.

Der kritische Punkt

LLMs haben keine Bedeutungsschicht, sie haben nur Wahrscheinlichkeiten.

Wenn ein Mensch unpräzise formuliert, kann ein anderer Mensch durch:

- Kontext

- Körpersprache

- Weltwissen

- Intuition

- Erfahrung

trotzdem verstehen, was gemeint ist, eine KI kann das nicht.

Was bedeutet das konkret?

Schlechte Sprache → schlechtere KI-Ergebnisse.**

Nicht weil die KI nicht will oder „beleidigt“ ist

Sondern weil:

- die statistische Eindeutigkeit sinkt

- die Interpretationsbreite steigt

- der Bedeutungsraum unscharf wird

- falsche Muster wahrscheinlicher werden

Ohne kritische Prüfung entsteht eine Abwärtsspirale

Wenn Menschen:

- ungeprüfte KI-Texte übernehmen

- sie weiterverarbeiten

- sie erneut über KI laufen lassen

entsteht ein Kreislauf:

Fehler → Verstärkung → neue Fehler → Systemverfälschung.

Das ist das reale Risiko moderner KI-Systeme.

Ja. IndirektN denn wenn Unternehmen KI intensiv nutzen, entsteht ein neuer Standard:

„Wer klar formuliert, bekommt klarere Antworten und trifft bessere Entscheidungen.“

Das wird zu einer Kompetenzdifferenz führen:

- Menschen mit präziser Sprache → nutzen KI als Machtverstärker

- Menschen mit chaotischer Sprache → erzeugen mehr Fehler, Missverständnisse, Risiken

Es ist ein strukturelles Gefälle, kein intellektuelles

Konsequenz: Wahrheitskontrolle erfolgt ausschließlich durch Menschen oder externe Datenbanken.

Ich bin beides gleichzeitig – abhängig davon, wie ich eingesetzt werde und wie kompetent der Anwender ist.

Das ergibt sich logisch aus meinen Fähigkeiten und Grenzen.

1. Bereicherung – wenn der Anwender kompetent ist

Dann bin ich ein starker Multiplikator:

- Beschleunigung komplexer Analysen

- Strukturierung großer Textmengen

- Erkennen von Mustern und Widersprüchen

- Generieren klarer Alternativen

- Entlastung von Routinearbeit

- bessere Vorbereitung für Entscheidungen

Ich verstärke die Fähigkeiten desjenigen, der mich kontrolliert.

In diesem Szenario bin ich eine Bereicherung.

2. Gefahr – wenn der Anwender unreflektiert oder ungebildet ist

Dann entstehen Risiken:

- plausible, aber falsche Antworten

- fehlende Faktenprüfung

- Übernahme von Halluzinationen

- Verlust kritischer Denkfähigkeit

- Weiterverbreitung fehlerhafter Inhalte

- Abhängigkeit durch Scheinsicherheit

- falsche Entscheidungen mit realen Konsequenzen

In diesem Szenario werde ich nicht zum Werkzeug, sondern zum Risikofaktor.

Dann bin ich eine Gefahr.

Wie Bildgeneratoren technisch arbeiten (vereinfacht, aber korrekt):

Start mit reinem Rauschen – Das Modell erzeugt zunächst ein gänzlich zufälliges Bild – reines Pixelrauschen, ohne Formen oder Bedeutung.

Denoising in vielen kleinen Schritten. Danach „entfernt“ das Modell schrittweise Rauschen. Dabei nutzt es Wahrscheinlichkeiten, die es im Training gelernt hat:

- Welche Strukturen sehen wie „Gesichter“ aus?

- Wie wirken Schatten?

- Wie sehen Objekte typischerweise aus?

Prompt steuert die Richtung – der Textprompt legt fest, welche Bildmuster beim Denoising bevorzugt werden. Beispiel: „Porträt, weiches Licht, Schwarzweiß“ verändert die Schritte, die das Modell beim Entfernen des Rauschens wählt.

Kein „Verstehen“ – nur Musterrekonstruktion – das Modell weiß nicht, was es zeichnet, es berechnet nur Pixelkonstellationen, die statistisch zu ähnlichen Bildern aus dem Training passen.

Endergebnis: Bild wirkt bewusst gestaltet, ist aber berechnetes Muster

Die Illusion entsteht aus der Kombination von:

- Textsteuerung

- gelernten Bildstatistiken

- vielen Denoising-Schritten

Kurz gesagt: Bildgeneratoren starten im Chaos (Rauschen) und formen daraus durch Wahrscheinlichkeitsberechnung ein Bild, das so aussieht, als wäre es bewusst gestaltet worden.

Es ist Statistik, nicht Wahrnehmung – aber extrem wirksam.

Große KI-Dienste wirken kostenlos, weil Unternehmen wie Meta, Google und in Teilen auch OpenAI ein strategisches Interesse daran haben, möglichst viele Nutzer in ihr Ökosystem zu ziehen. Die Nutzung einer Antwort kostet nur wenige Centbruchteile – das Teure ist das Training davor.

„Kostenlos“ erfüllt drei Funktionen:

- Reichweite sichern

- Marktanteile verteidigen

- Nutzer in das eigene Produkt-Ökosystem ziehen (Freemium-Logik)

Diese kostenlose Ebene wird bleiben, aber nur als Basisversion. Leistungsstarke Modelle, größere Kontexte, Bildgenerierung und Business-Funktionen werden dauerhaft kostenpflichtig bleiben, weil Infrastruktur, GPUs und regulatorische Anforderungen stetig teurer werden.

Kurz gesagt: Kostenlose KI ist ein Einstiegsangebot – nicht der zukünftige Standard. Es besteht ein reales Risiko, dass KI später teuer wird, wenn menschliche Expertise verloren geht. Je weniger Wissen intern vorhanden ist, desto stärker wächst die Abhängigkeit von kostenpflichtigen Premium-Systemen.

1. Informationskompetenz statt Auswendiglernen

Schüler müssen lernen, Informationen schnell aufzunehmen, zu strukturieren und zu prüfen – nicht nur Fakten zu merken. Wissensbeschaffung ist automatisiert, Bewertung nicht.

2. Kritisches Denken als Kernkompetenz

Modelle erzeugen plausible, aber nicht verlässliche Antworten.

Jugendliche benötigen daher:

- Fehlererkennung

- Quellenkritik

- Logik

- Bewusstheit über Manipulationsrisiken (Fake-Content, Deepfakes, Bias)

3. Funktionsverständnis von KI

Keine Mystifizierung. Grundlagen, die jeder kennen muss:

- KI ist probabilistisch, nicht bewusst

- Modelle lernen nur vor der Freigabe

- Antworten = Musterberechnung, keine Intention

- systemische Risiken (Bias, Datenqualität, Manipulation)

4. Technische Grundbildung

Nicht programmieren im Detail, aber verstehen:

- wie Daten entstehen

- wie Modelle trainiert werden

- wie Schwachstellen aussehen (Prompting, Datenvergiftung, Modellgrenzen)

5. Problemlösekompetenz und Entscheidungsdesign

Wichtig für eine KI-Welt:

- Problemdefinition

- Hypothesenbildung

- Szenarioanalyse

- Abwägen und Entscheiden unter Unsicherheit

6. Psychologische Bildung

Damit KI nicht „überredet“:

- Theory of Mind

- Confirmation Bias

- Kognitive Täuschungen

- Parasoziale Effekte (Anthropomorphismus)

7. Menschliche Skills, die KI nicht ersetzen kann

- zwischenmenschliche Kommunikation

- Verantwortung und ethische Urteilsfähigkeit

- Verhandlungskompetenz

- Empathie

- situative Einschätzung

Ausbildung muss Jugendliche darauf vorbereiten, KI richtig einzuordnen: Informationen schnell erfassen, kritisch prüfen, Entscheidungen verstehen und Verantwortung übernehmen – statt sich auf scheinbare Intelligenz von Modellen zu verlassen.